Hrozby rozšířené reality: změní deep voice svět, jak ho známe?

Videa s falešnými obličeji strhla v posledním roce velkou dávku pozornosti, jenže slyšeli jste už o falešném hlase? Ten je ještě mnohem reálnější a hrozba jeho zneužití roste do závratných výšin…

O technologii deepfake jsme psali už několikrát. Možnost upravit video prostřednictvím nasazení libovolného obličeje na kohokoli byla zatím využita především k humorným účelům, ale samozřejmě také v pornografii. Jednalo se tak přinejhorším o nactiutrhačná díla, jež nepotěšila toho, kdo se stal cílem těchto vtípků; což je bezesporu nepříjemné, ale může být hůř. A takový moment bohužel není vzdálený.

Deepfake a deep voice

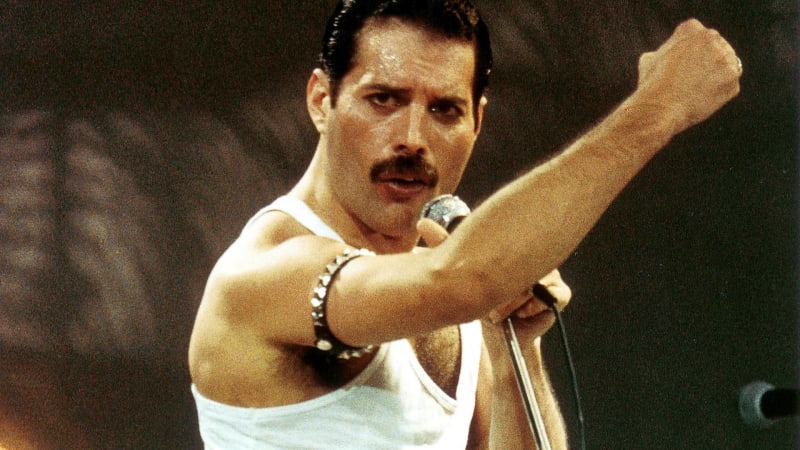

Vedle deepfake se totiž vyvinula i technologie s názvem deep voice a možná si dokážete domyslet, v čem asi spočívá. Stačí nahrát krátký záznam něčího hlasu (předloni se jednalo o několik minut, nyní údajně stačí pouhých několik sekund!), z něhož algoritmus vyhodnotí barvu hlasu i základní prvky intonace a následně dokáže libovolný text napasovat právě na tyto charakteristiky. Vytvořit těžko rozeznatelný záznam hlas Baracka Obamy či Donalda Trumpa je tak otázkou několika minut práce. A není divu, proč v zámoří využívají zrovna hlasy svých prezidentů – právě oni totiž mají největší moc a jakýkoli nešťastný výrok vyvolá obrovskou odezvu; a co teprve když se bude jednat o podvod!

Technologie samozřejmě není volně dostupná a je v rukou několika firem s velmi omezenými možnostmi použití. Tyto společnosti se samozřejmě distancují od jakéhokoli nebezpečného použití a tvrdí, že chtějí pouze zprostředkovat nový typ zážitků. Hlas jakékoli známé osoby bude muset být před použitím schválen, což by mělo předejít podvodům. Jenže všichni víme, jak to ve skutečnosti funguje – když taková technologie existuje, je jen otázkou času, než se rozšíří i do nepovolaných rukou. Američtí odborníci na dezinformace před těmito pokroky varují a vyzývají k reflexi toho, jak vnímáme realitu. Ověřené zdroje budou do budoucna podstatnější než kdy dřív, ovšem zase jednou se ukazuje, že technologie jsou o krok napřed před legislativou; a možná víc než jen o jeden.

Zřejmá nebezpečí

Samozřejmě že by taková možnost mohla být použita pro čtení hlasem, který si vyberete. Můžete třeba nahrát několikasekundový projev vaší partnerky či partnera, a následně si nechat číst libovolnou knihu právě jeho či jejím hlasem a intonací. To je ovšem ten nejromantičtější a nejideálnější scénář – mnohem pravděpodobnější varianty si však dokážete domyslet sami. Odposlechy jako policejní materiály, libovolné audio záznamy politiků či jiných vysokých funkcionářů, to vše může být rázem velmi snadno upravitelné. Zatímco deepfake videa jsou stále víceméně rozpoznatelná (i když není pochyb o tom, že časem to bude opravdový oříšek), videa vytvořená pomocí deep voice jsou nedaleko dokonalosti už nyní. Důvěra ve vše, co slyšíme, tak může být velmi riskantní…

Text: MS