Duo studentů naučilo umělou inteligenci hrát střílečku Doom. Začala porážet lidi

Máme umělou inteligenci učit zabíjet – ač jen digitálně?

I když jsme stále na hony vzdáleni "skutečné" umělé inteligenci, jež bude samostatnou bytostí, méně schopné umělé inteligence vznikají každý den. Nejnověji vzbudil rozruch program dvou studentů, který se sám naučil hrát kultovní střílečku Doom. Vyvolal totiž pochyby nad tím, jak vážně berou výzkumníci Asimovy zákony.

Inteligence z garáže

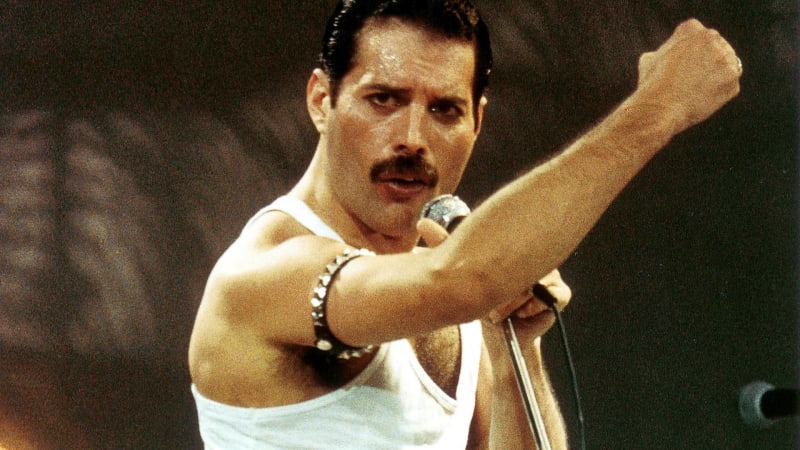

Pokud proliferaci výzkumu a vývoje umělé inteligence (AI) něco dokládá nejlépe, pak skutečnost, že za nejnovější kontroverzí není armáda ani korporace. Guillaume Lample a Devendra Singh Chaplot, dva studenti americké Carnegie Mellon University, strávili 4 měsíce vývojem AI, již pojmenovali Arnold. Tato byla s to čistě pozorováním hraní lidských hráčů (resp. jejich monitorů) "pochopit" a okoukat ideální hrací styl.

Arnold se zcela sám naučil chodit, střílet i uhýbat, zcela bez jiné podpory. Právě schopnost rozeznat vizuální podněty je velkým tématem informatiky – už jen kvůli tomu, aby mohly samořídicí vozy jednou převzít lidské otěže. Sám Arnold nakonec přemýšlel tak dobře, že na soutěži vícera podobných studentských umělých inteligencí porážel lidské protihráče, že klání jménem Visual AI Doom Competition vyhrál.

Není to však poprvé, kdy AI zvládla okoukat herní styl a naučit se hrát hry. Doposud počítače dominovaly hlavně 2D hrám, trojrozměrný Doom je proto mírným krokem kupředu. Jde však o nadějný projekt dvou studentů, kteří jednou mohou posunou hranice vývoje umělé inteligence dále, když již nyní zvládají to, co bylo ještě před pár lety výspou korporátních laboratoří.

Nebyl by to však internet, kdyby si celou záležitost mnozí nevzali osobně a nevarovali nad možností, že se Arnold zmocní jaderného arzenálu a přejmenuje se na Skynet. Noviny jako Daily Mail či server Salon tak pojaly celou zajímavost jako varování před riziky inteligentních mašin trénovaných zabíjet, což prý porušuje známý první Asimův zákon robotiky znějící: "Robot nesmí ublížit člověku nebo svou nečinností dopustit, aby bylo člověku ublíženo."

Jak funguje umělá inteligence

Asimov však své teze formuloval v době, kdy se mělo za to, že sestavit skutečnou, tzv. silnou umělou inteligenci bude relativně snadné, ale naučit ji "chovat se" bude o něco složitější. Ještě v 80. letech si výzkumníci mysleli, že roboti schopní naučit se lidskému chování jsou jenom otázkou stále vyšší výpočetní kapacity počítačů. Dnes víme, že teprve neuronové sítě jsou zřejmě cestou kupředu, a umíme vytvářet jednoduché & velmi specificky zaměřené programy (jako třeba Arnolda), avšak plnokrevná umělá bytost je stále stejně vzdálená jako za dob Asimova.

Arnold tak není a ze své podstaty ani nemůže být základem vojenských robotů o nic víc než například programy čtoucí čidla samořídicích vozů Googlu. Nemá žádné rozkazy, není s to vyhodnocovat cíle anebo si je sám vymýšlet. Kdybyste ho přetáhli do vojenského dronu, nebude "chápat", co má dělat. Skutečná válka je totiž podstatně méně o nutnosti rychle reagovat jako v Doomovi, a podstatně více naopak spoléhá na výběr cílů, koordinaci, schopnosti nezastřelit vše v okolí. Jako třeba své spolubojovníky.

Co na to US ARMY?

Naposledy se to potvrdilo na jaře, kdy v armádním výzkumu došlo na dvě zajímavé události. Předně zástupce amerického ministerstva obrany vyzval, aby došlo na veřejnou debatu kolem definice a meritů autonomních vojenských strojů. Neboli jednoduše… vojenských robotů. Prakticky všechny dnešní vojenské stroje bez přítomnosti člověka jsou totiž dálkově řízené – jenže to obvykle znamená možnost řízení vyrušit, což činí stroje zranitelné. U letadel to tolik nevadí, jsou s to přerušit misi a vrátit se na letiště. Ale hypotetické pozemní stroje potřebují bleskovou reakční dobu i schopnost opětovat palbu. Ministerstvo obrany přitom vyzvalo k debatě tónem, jenž nevylučuje ani možnost mezinárodního zákazu podobných zbraní.

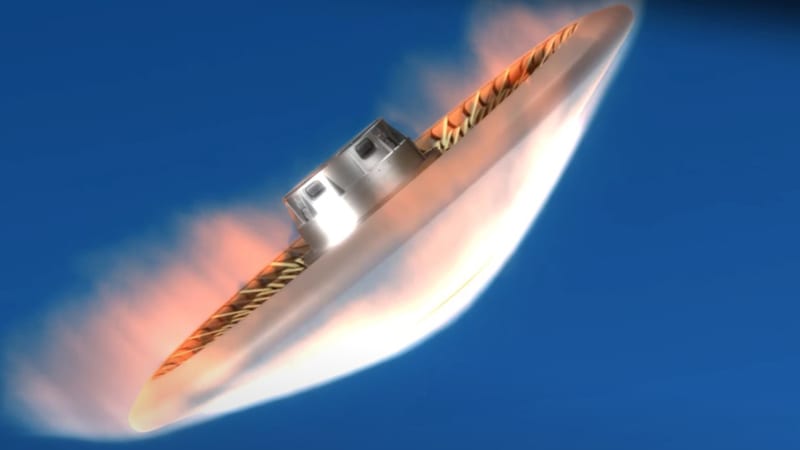

Na druhou zajímavost došlo, když se americká námořní pěchota pokusila testovat chodící čtyřnožce Boston Dynamics (vynálezce známé robotické muly BigDog) v bojových podmínkách. Idea byla, že by stroje byly osázeny kamerami, časem snad i zbraněmi, a mohly by zkoumat, nebo dokonce přímo čistit budovy během městského boje. Ukázalo se však, že i dnešní roboti jsou k tomu nevhodní vlivem citlivosti strojů a nadměrného hluku, jenž generují.

Svět vojenských robotů se možná skutečně přibližuje, rozhodně ovšem stále není „za rohem“ a kritici umělých inteligencí by však udělali mnohem lépe, kdyby se snažili vyvolat debatu kolem možností regulace chytrých zbraní (podobně jako se to v 60. letech povedlo u zbraní jaderných), než aby plísnili talentovaný projekt dvou studentů.

Text: Ladislav Loukota