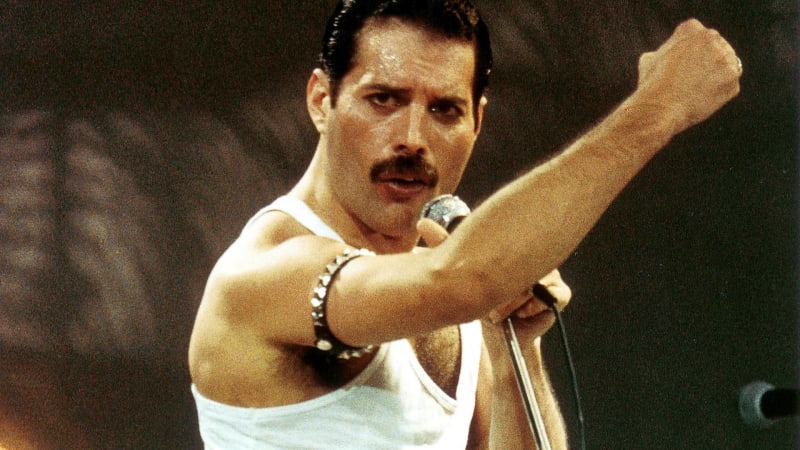

Detekce obličeje přinese obrovské problémy. Dělá totiž zásadní chyby!

Systémy na rozpoznání obličeje budí obavy týkající se policejního státu a nadměrné kontroly, především však nefungují tak dokonale, abychom se na ně mohli spolehnout. Což je aktuálně v USA kvůli technologii Amazonu velký problém.

O futuristických snahách boje se zločinem jsme psali už několikrát. Ať už se ale jedná o umělou inteligenci či skenování duhovek, žádný systém se zatím neukázal jako zjevné řešení kriminality pro budoucí dekády. Se svou troškou do mlýna v posledních letech přišel i obchodní – a nějakou dobu už i technologický – gigant Amazon, který v roce 2016 začal hovořit o systému rozpoznávání obličejů. Jenže zatím se zdá, že tahle vymoženost přináší víc problémů než užitku.

Poznáme všechny obličeje?

Během loňského roku totiž Americký svaz občanských svobod (ACLU) zveřejnil výsledky svého testování této technologie. Použil databázi 25 000 veřejně přístupných fotek vězňů a porovnal je s 535 členy amerického Kongresu. Systém Amazonu ve 28 případech našel shodu, což znamená, že váženého zámořského politika identifikoval jako zločince. Pro jistotu dodáme, že žádný z tamějších hodnostářů v databázi muklů skutečně nebyl…

Zástupci ACLU se tak snažili zákonodárce přesvědčit, že plánované nasazení systému na rozpoznávání obličejů by teď bylo uspěchané, neboť technologie ještě zdaleka není připravená na běžný provoz. Zástupci Amazonu výsledky pochopitelně popřeli tvrzením, že kalibrace systému ze strany ACLU nebyla dostatečná, stejně jako nastavení pouze 80% shody porovnávaných fotografií; pro využití v boji se zločinem by podle Amazonu měla být nastavena nutnost alespoň 95% shody, aby se právě takovýmto situacím předešlo.

V praxi se tak jedná o takzvanou chybu prvního druhu, jak se ve statistice označuje falešná pozitivita. V takových případech se vědci domnívají, že nalezli významnou spojitost mezi některými jevy a mohou tak říct, že něco funguje – avšak není to pravda. Vzhledem k tlaku na publikování výzkumů s pozitivními výsledky (tedy prokázaným nějakým efektem) je chyba prvního druhu (známá také jako Othellova chyba, plynoucí z unáhlenosti) stále častější, ale to by bylo na jiné povídání. Problém je to každopádně nezanedbatelný.

Riskantní výsledky aneb Můžeme věřit technologiím?

Zmíněná ukázka sice nejspíše opravdu nebyla ideálně nastavena, a tak jsou výsledky poněkud tendenční, obavy kritiků systému však není radno brát na lehkou váhu. Opět se totiž může jednat o další nástroj kontroly, na který mohou nevinní a bezúhonní občané doplatit. Nemluvě o tom, že se stále jedná o technologii v rukou soukromé (a velmi mocné) firmy, což opět probouzí rozličné orwellovské představy.

Proti systému se postupně vzbouřila i řada akcionářů Amazonu, kteří žádali o zastavení vývoje kontroverzní technologie. Amazon se zatím úspěšně brání tím, že sám volá po zavedení dostatečně propracované legislativy, jež by pomohla případným problémům předejít. Aby toho nebylo málo, nedávno se navíc objevila zjištění, že systém hůře identifikuje osoby tmavší pleti a ženy; za oceánem se tak navíc rozjela debata o rasové a genderové diskriminaci, neboť vyšší šance na správnou identifikaci v případě bílých mužů a naopak nižší u žen a etnických menšin je dostatečnou rozbuškou. Uvidíme, jak se bude situace nadále vyvíjet, avšak doufejme, že se plnohodnotné nasazení těchto technologií neuspěchá, neboť v takovém případě by nastalo více problémů, než kolik by se vyřešilo…

Text: MS